Cel sztucznej inteligencji

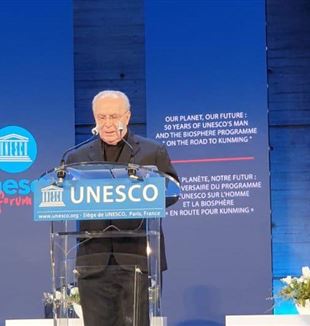

Fragmenty wystąpienia prałata Francesco Follo, ówczesnego Stałego Obserwatora Stolicy Apostolskiej przy UNESCO, wygłoszonego na spotkaniu „Zalecenia w sprawie etyki sztucznej inteligencji” w 2021 rokuCzy maszyna będzie w stanie myśleć - w pełnym tego słowa znaczeniu? Czy będzie w stanie pod każdym względem zrównać się z człowiekiem dzięki swojemu integralnemu życiu intelektualnemu? Są to niektóre z najgłębszych i najbardziej radykalnych pytań, jakie rozwój sztucznej inteligencji stawia przed ludzkością. Do tej pory maszyna, która odtwarza szczegóły organizacji mózgu i jest w stanie wykazywać wszystkie najwyższe cechy ludzkiej inteligencji, w tym samoświadomość, wydaje się wykraczać poza zakres obecnego lub konkretnego przewidywalnego rozwoju technicznego. Istnieją jednak maszyny (lub programy komputerowe) zdolne do wykonywania złożonych operacji z wydajnością porównywalną - a czasem, w określonych kontekstach, nawet przewyższającą - ludzką. Budzi to optymizm, który pozostawia otwartą, przynajmniej dla niektórych, możliwość - bez względu na to, jak odległą - spełnienia pewnego dnia życzeń „silnej” sztucznej inteligencji, tj. maszyn tak podobnych do ludzi, że mogą nawet rozwinąć samoświadomość.

Moim zdaniem istnieją co najmniej trzy aspekty, które utrudniają myślenie, że pewnego dnia maszyny będą w stanie całkowicie zastąpić ludzką inteligencję: wymiar afektywny, wymiar semantyczny i trzeci wymiar, który na razie nazwałbym „motywacyjnym”.

Dziś wydaje się jasne, nawet z eksperymentalnego punktu widzenia, że stany emocjonalne wpływają na podejmowanie decyzji i racjonalne procesy: wybory. Dlatego „silna” sztuczna inteligencja, która zamierzała odtworzyć ludzką inteligencję pod każdym względem, musiałaby również odtworzyć jej emocjonalne i afektywne aspekty. Ale wprowadzenie tego wymiaru do „myślących maszyn” sprawiłoby, że ich postęp byłby mniej „racjonalny”. Rozważania te stawiają głębokie pytanie tym, którzy z technicznego punktu widzenia zajmują się sztuczną inteligencją: jaki powinien być cel tych technologicznych osiągnięć? Odtwarzanie i naśladowanie ludzkiej inteligencji, czy też wspieranie jej w określonych kontekstach i dziedzinach, pozostawiając integralne i ogólne aspekty człowiekowi z krwi i kości, rozumowi i uczuciom?

Drugi problematyczny aspekt „silnej” sztucznej inteligencji wiąże się z klasycznym już w nowoczesnej i współczesnej filozofii języka rozróżnieniem na składnię i semantykę. Powszechnie uważa się, że komputery, w tym te, które mają wspierać sztuczną inteligencję, mogą radzić sobie jedynie ze składniowymi powiązaniami między pozbawionymi znaczenia symbolami, podczas gdy nie mogą poradzić sobie z semantyczną treścią przypisywaną takim symbolom. To samo w sobie stanowiłoby ogromne ograniczenie dla możliwości stworzenia sztucznej inteligencji, która mogłaby w pełni naśladować ludzką inteligencję, której fundamentalnym wymiarem jest wszechświat znaczeń. Często uważa się, że semantyka jest jedynie siecią relacji między terminami. Na przykład, jeśli wyszukujesz termin w słowniku, jest on definiowany przez inne powiązane terminy. „Kalendarz” definiowany jako zestaw arkuszy pokazujących dni, tygodnie i miesiące w roku. Ci, którzy znali znaczenie wszystkich terminów użytych w tej definicji, mogli zrozumieć termin „kalendarz”; ci, którzy nie znali niektórych z nich, mogli kontynuować wyszukiwanie w słowniku, rekursywnie. Jednak bez względu na to, jak daleko posunięty jest ten proces, osoba, która nigdy nie widziała ani nie posiadała kalendarza, miałaby trudności z prawdziwym zrozumieniem tego terminu: w rzeczywistości zależy to również w dużej mierze od rzeczywistych doświadczeń życiowych mówiącego. Znaczenie słów takich jak „ubóstwo” czy „wolność” zmienia się znacznie w zależności od sytuacji osobistej, historii życia, a także ogólnego kontekstu historycznego lub geograficznego, w którym się znajdujemy. Znaczenia są konotowane zarówno emocjonalnie, jak i racjonalnie. Na tej podstawie stworzenie maszyn, które mogą odtworzyć każdy aspekt ludzkiej inteligencji, wymagałoby nie tylko wystarczającej mocy obliczeniowej, ale także zdolności do życia jak człowiek. Nie tylko do obliczania symboli, ale także do doświadczania: cierpienia i radości, pragnienia i strachu, widzenia, słyszenia, dotykania, wąchania i smakowania. W tym momencie sztuczna inteligencja oznaczałaby również „sztuczne życie”, a problemy napotykane przy próbach stworzenia „żywych maszyn” są co najmniej tak duże i równie poważne, jak te napotykane przez sztuczną inteligencję.

Dochodzimy do trzeciego wymiaru, który nazwałem „motywacyjnym”. Dziś jest jasne, że wiele aspektów ludzkiej inteligencji pochodzi z długiej ścieżki ewolucyjnej, która doprowadziła do powstania naszego gatunku biologicznego. Niektóre z tych aspektów są również wspólne - przynajmniej częściowo - dla innych gatunków zwierząt, niebędących ludźmi. Powszechnie wiadomo również, że zgodnie z teoriami dotyczącymi ewolucji biologicznej, innowacje, które pojawiły się w historii naturalnej, również z behawioralnego i poznawczego punktu widzenia, odpowiadają logice konieczności: w historii ewolucji to, co pojawia się dla różnych gatunków biologicznych w różnych kontekstach środowiskowych, jest niezbędne do przetrwania bez poddawania się wyzwaniom środowiskowym. Te ramy koncepcyjne, choć z pewnością ważne dla wielu aspektów nawet ludzkiego poznania, nie wydają się być w stanie w pełni wyjaśnić ewolucji kulturowej charakterystycznej dla historii ludzkości. Udomowienie roślin i zwierząt, budowa miast i miejsc kultu, wynalezienie pisma i arytmetyki, pojawienie się tak zwanej kultury teoretycznej, uniwersytetów, nowoczesnej nauki, rewolucje przemysłowe, które zaznaczyły się w ciągu ostatnich kilku stuleci: wszystko to trudno przypisać wyłącznie konieczności w wyżej wymienionym sensie. Żadna z tych innowacji (i niezliczonych konkretnych wynalazków, które im towarzyszyły), ściśle rzecz biorąc, nie była konieczna dla przetrwania istot ludzkich. Kwestia ta jest jeszcze głębsza, gdy spojrzymy na nią z perspektywy jednostek, które wniosły istotny wkład w te postępy. Pomyślmy o Sokratesie, który w imię prawdy i sprawiedliwości pozwolił się zmusić do popełnienia samobójstwa, czy o Galileuszu, który w przekonaniu o słuszności swoich kosmologicznych idei przeszedł przez dwa procesy. Refleksje te z całą mocą stawiają problem motywacji, które popychają istoty ludzkie do poszukiwania, chęci poznania i tworzenia, zbliżania się do prawdy i pragnienia poprawy swoich warunków materialnych i duchowych wychodząc poza wąskie potrzeby.

CZYTAJ TAKŻE: Różnorodne inteligencje

Kwestia ta stanowi kolejny problem jeśli chodzi o cel „silnej” sztucznej inteligencji. Myśląca maszyna, która chciałaby w pełni odtworzyć ludzką inteligencję, musiałaby również być w stanie odtworzyć ten „motywacyjny” aspekt. Innymi słowy, powinna być w stanie nie tylko wykonywać inteligentne operacje w celu rozwiązywani przypisanych zadań, ale także samodzielnie przypisywać zadania i cele, mieć aspiracje. Obecnie zaawansowane sieci neuronowe i tak zwane „systemy eksperckie” są w stanie wykonywać inteligentne operacje w sposób porównywalny - a czasem nawet lepszy - niż ludzie. W niektórych przypadkach mogą to nawet zrobić, opracowując rozwiązania, które wcześniej nie były wprowadzane do systemu. Jednak nie tylko mogą to robić tylko w ograniczonych i ściśle opisanych domenach, ale przede wszystkim nie przypisują sobie celów, które mają zostać osiągnięte. Prawdziwa „silna” sztuczna inteligencja powinna natomiast być w stanie to zrobić. To nie przypadek, że w wielu filmach na ten temat pojawia się, w taki czy inny sposób, wątek maszyny buntującej się, chcącej samostanowić o sobie, chcącej „stać się człowiekiem”, chcącej chronić ludzkość, a nie podporządkowywać ją sobie i podbijać Ziemię. Nie wydaje mi się, aby którykolwiek z trwających lub realistycznie przewidywalnych rozwojów, mógł naprawdę doprowadzić do takiego wyniku.

*Stały obserwator Stolicy Apostolskiej przy UNESCO w latach 2002-2021. „Zalecenie w sprawie etyki sztucznej inteligencji” zostało przyjęte przez Zgromadzenie Ogólne UNESCO 23 listopada 2021 r.